- 首先给大家推荐一款网站AI工具集官网 | 1000+ AI工具集合,国内外AI工具集导航大全

可以帮助我们检索想要了解和使用的AI工具。

下面是正片:

1.百度搜索“月之暗面”

2.进入官网

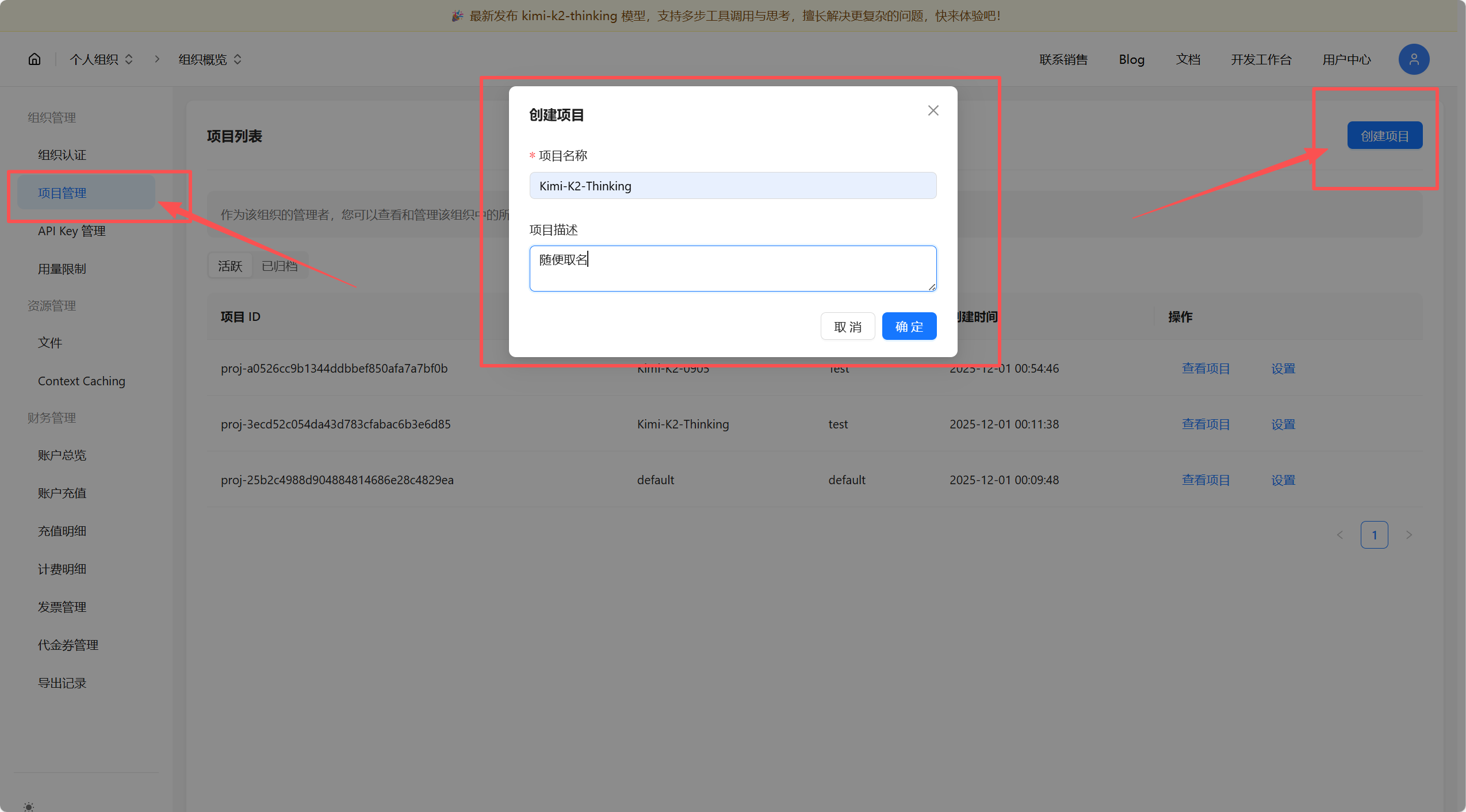

3.点击进入:Kimi开放平台,然后在右上角点击登录,登录后是这样

4.点击用户中心、申请APIKey

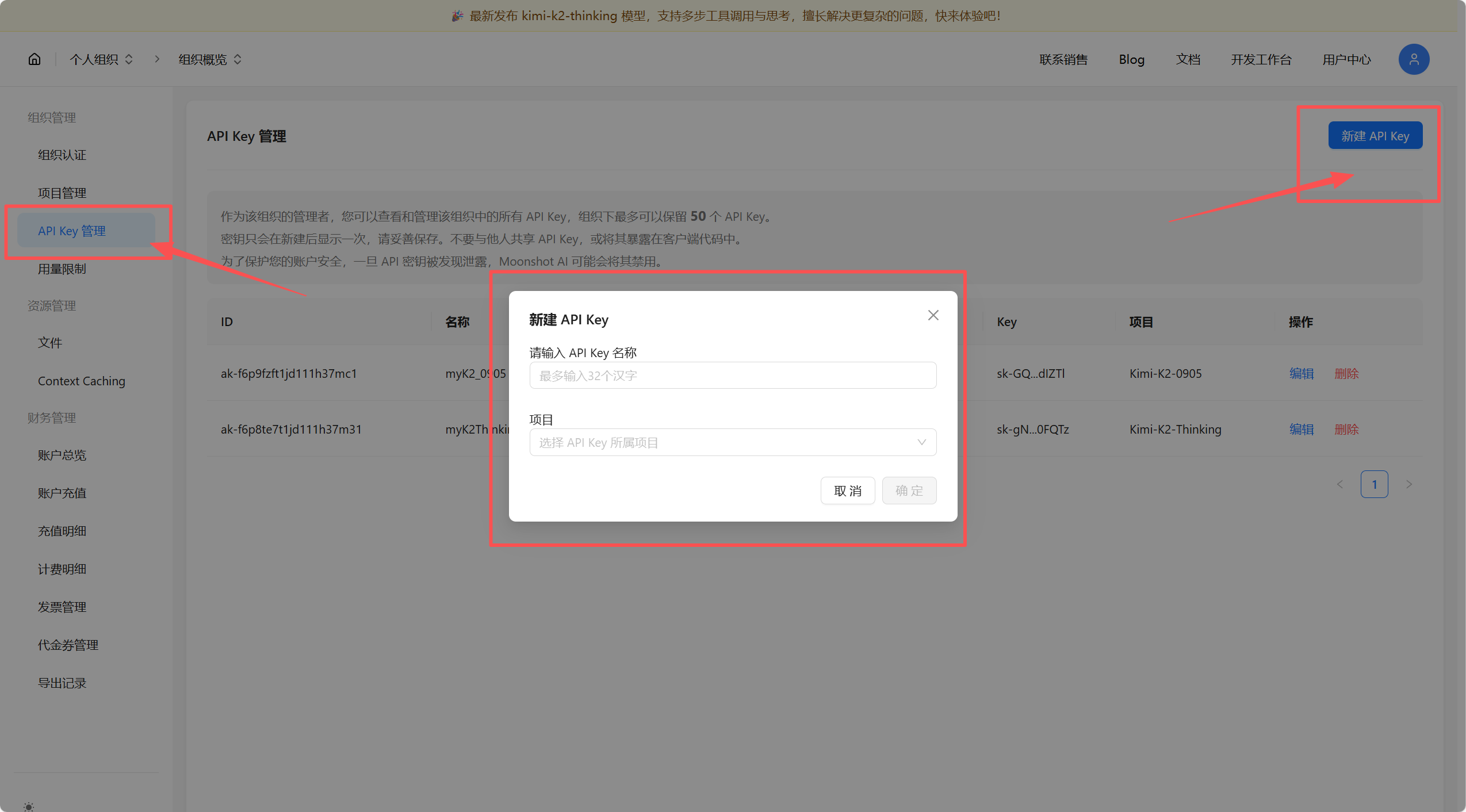

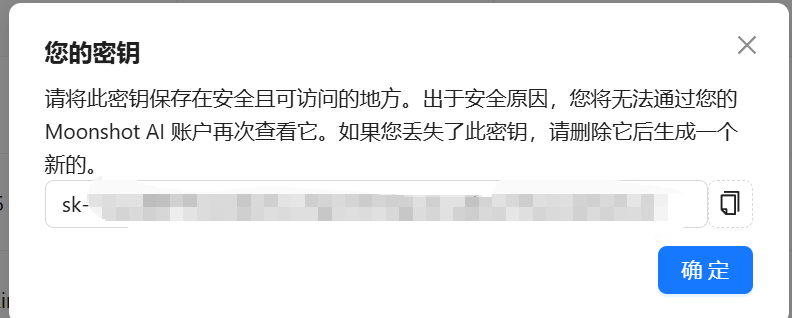

5.点击API Key 管理,进行创建,名字随便取,创建完成后就能正常创建API Key 了

6.点击API Key 管理,进行创建,名字随便取,然后选择刚才创建的项目

完成后一定要保存好API Key !!!

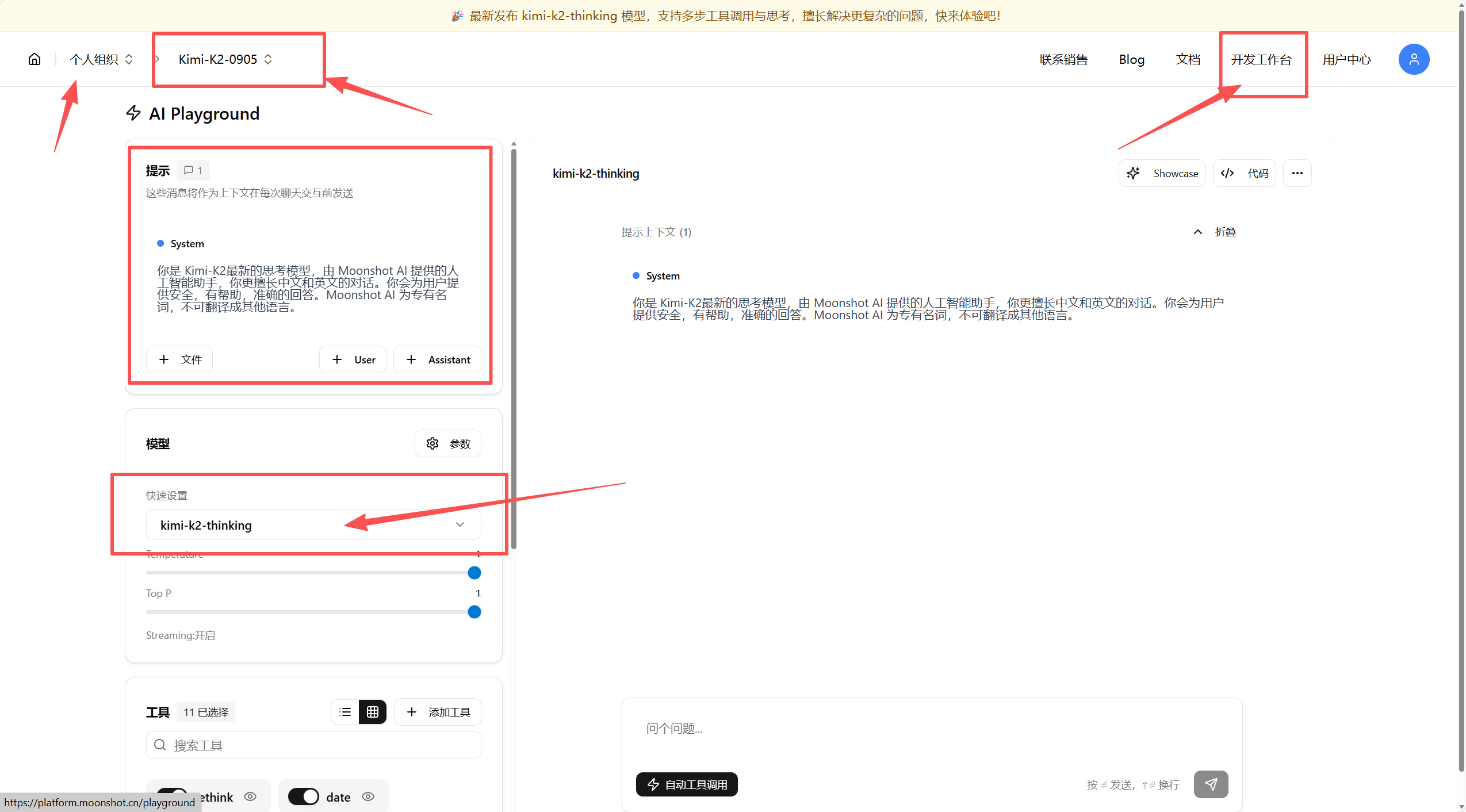

7.然后点击“开发工作台”,在模型区选择你想要的模型,确定好你的项目名,在提示中配置规则。

8.其他配置不用变动,现在就已经完成了API Key 的创建了,可以随便使用了!

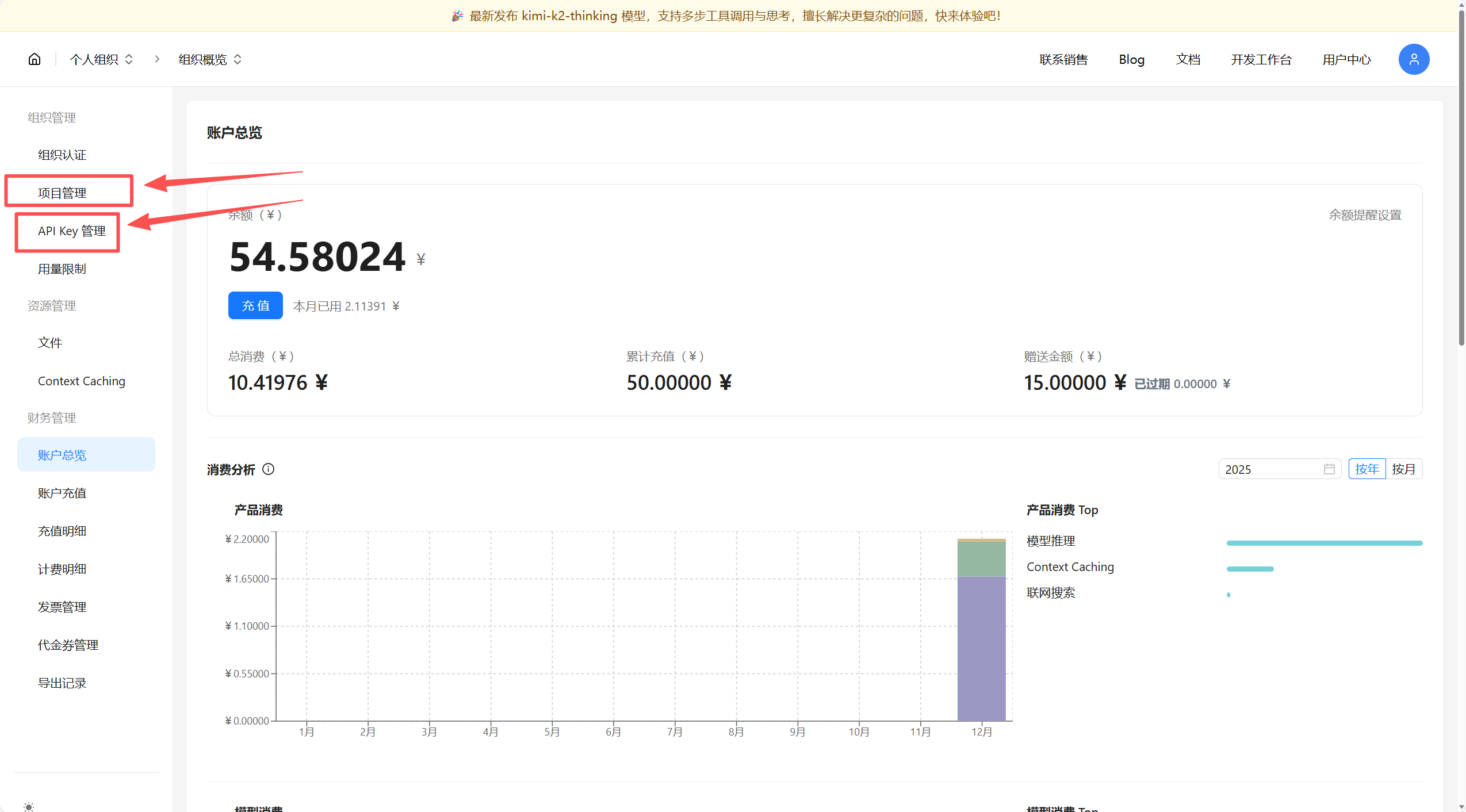

官方会赠送新用户 15 RNB ,Kimi-K2-Thinking够用很多次,综合下来写几个页面、改改bug还是可以。

你也可以像我一样小充一波支持一下国产 AI,提示你的使用体验同时增强AI的性能。

而且官方会优先使用你的免费额度,效果如下:

9.接下来是使用教程:

1.如果你要搭建 chat 机器人/智能体,则直接参考官方文档,结合AI工具一起开发即可。

官方文档非常详细,大家一起去试试吧!

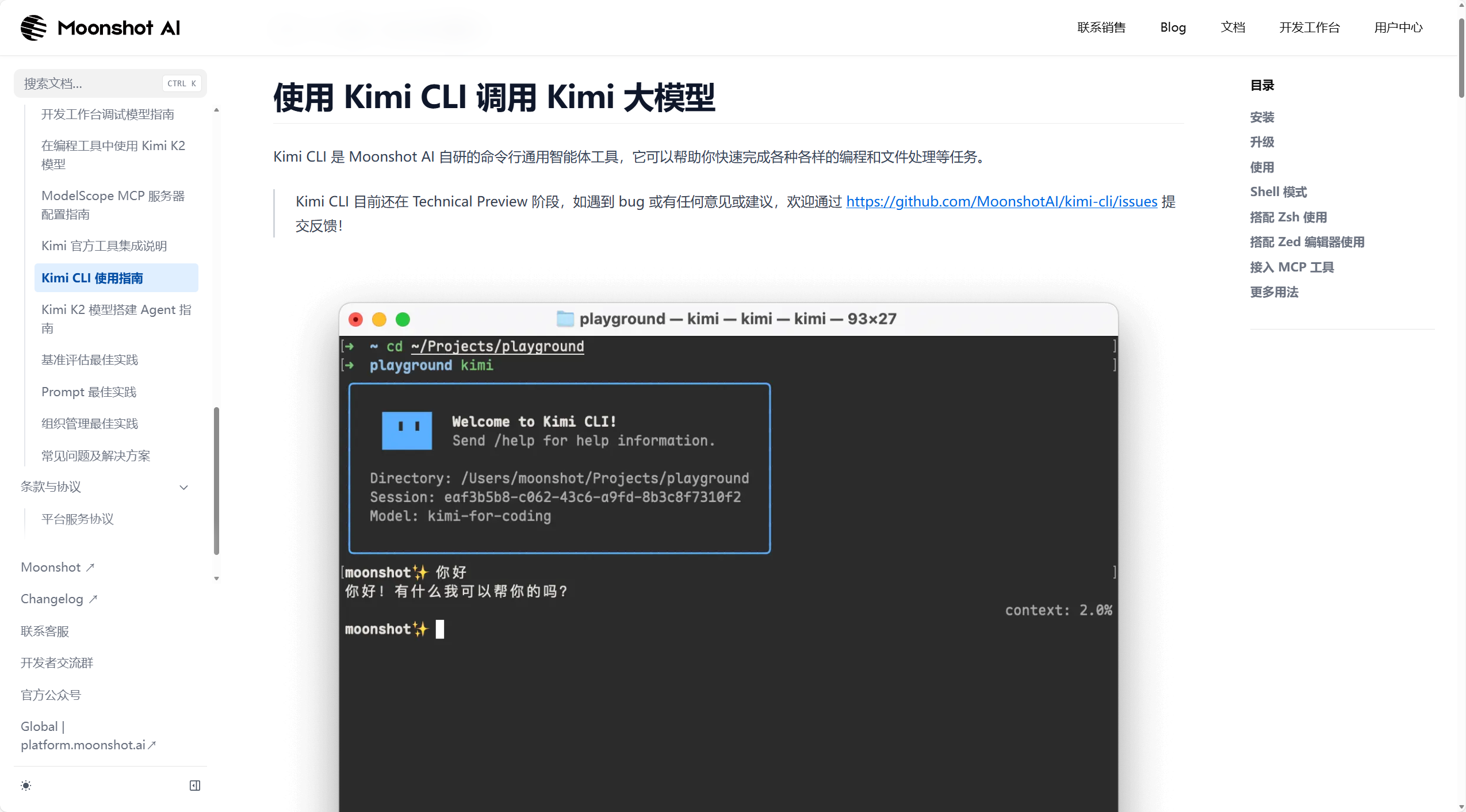

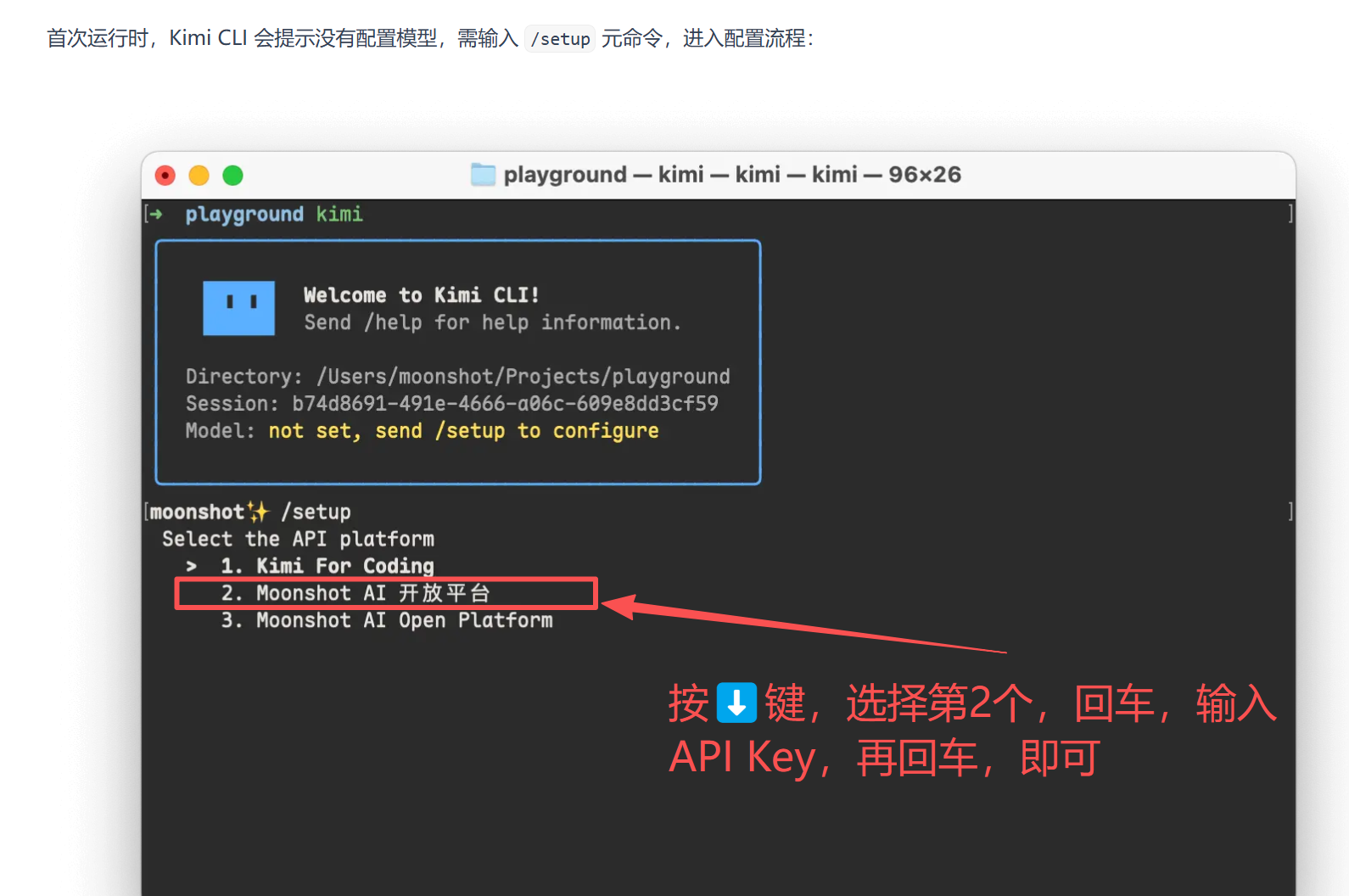

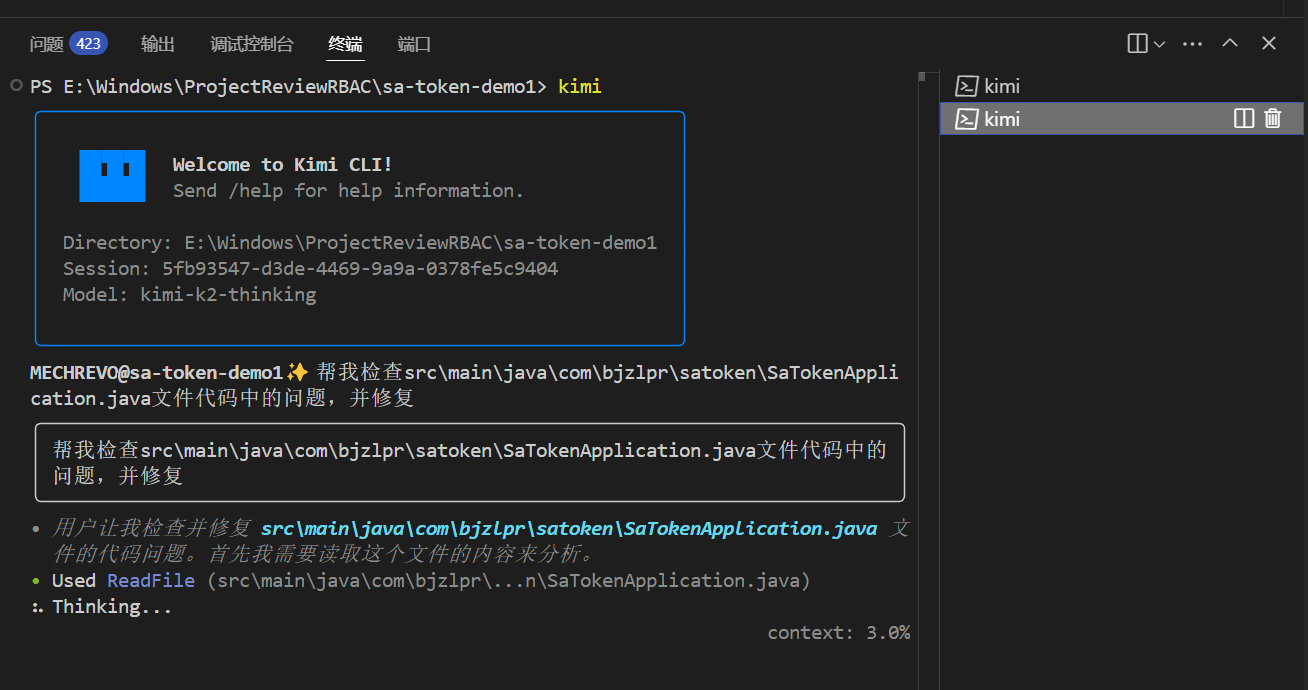

2.使用 Kimi CLI 调用 Kimi 大模型

按照官方文档的步骤操作:

安装

Kimi CLI 支持 macOS 和 Linux 系统,要求使用 uv 包管理器安装。

如果你的系统中还没有安装 uv,请先参考 uv 安装说明 进行安装。通常,在 macOS 和 Linux 系统中,可使用以下命令安装 uv:

curl -LsSf https://astral.sh/uv/install.sh | sh安装 uv 后,使用以下命令安装 Kimi CLI:

uv tool install --python 3.13 kimi-cli运行以下命令检查是否安装成功:

kimi --version由于 macOS 的安全校验机制,在 macOS 上第一次运行可能需要较长时间,请耐心等待。可以尝试将你所使用的终端工具添加到「系统设置」-「隐私与安全性」-「开发者工具」中,以信任终端上运行的程序。

升级

使用以下命令升级 Kimi CLI:

uv tool upgrade kimi-cli --no-cache使用

在命令行中进入你想要 Kimi CLI 操作的项目目录,运行 kimi 命令,即可启动 Kimi CLI。例如:

cd my-projectkimi

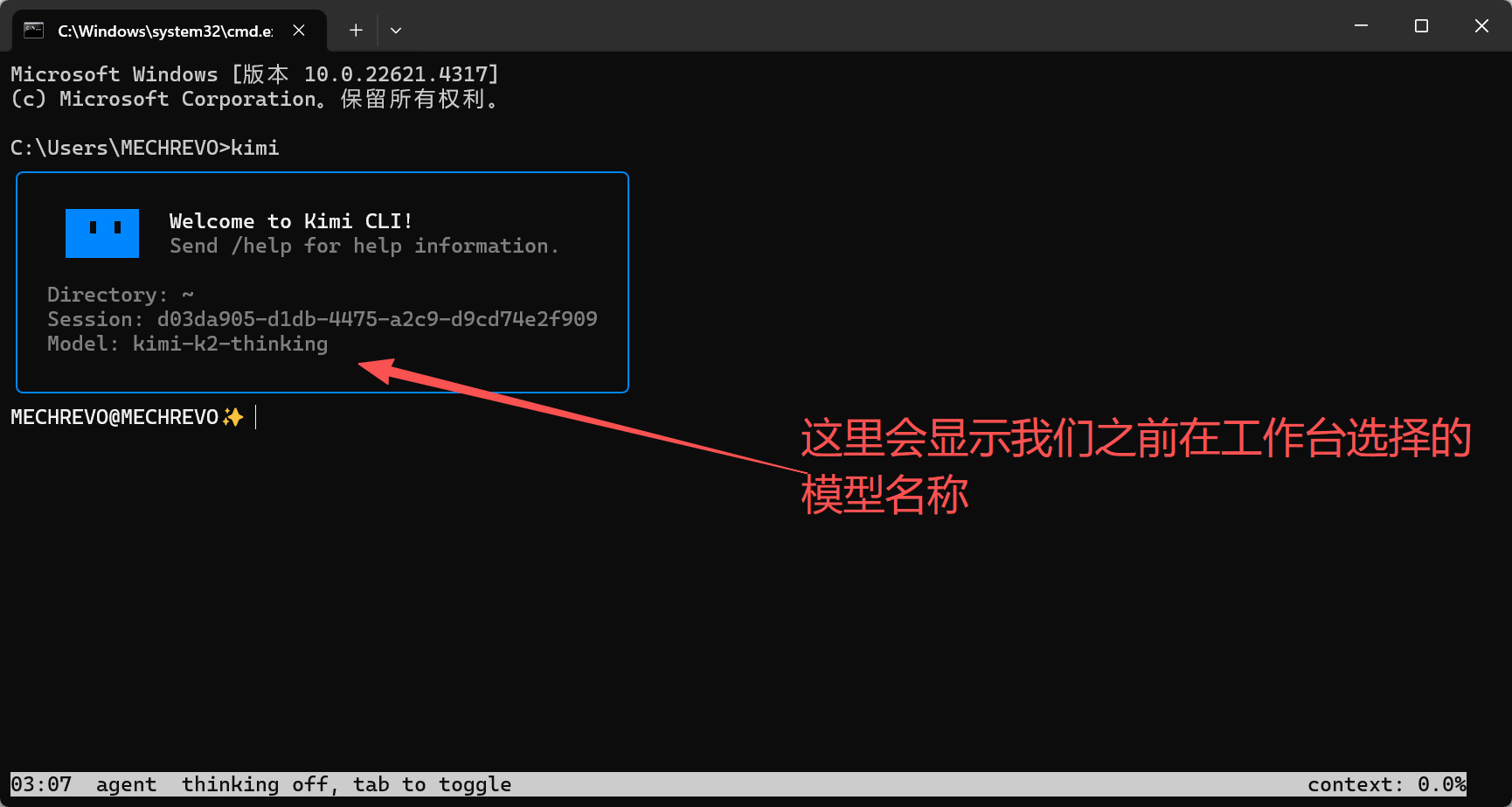

下面是在Windows的cmd中输入kimi后的画面:

大功告成!以后我们就可以在任意的编译器终端中打开 kimi 了 😄

小提示:充值50RMB以上金额会提高自己的Kimi模型的并发数,能体验到在编译器里打开多个终端进行多线程运行kimi执行编程任务的快感,极大提示开发效率!

在 Claude Code 中使用 kimi k2 thinking 模型

安装 Claude Code

若您已安装好 Claude Code ,可以跳过这一步

MacOS 和 Linux

# MacOS 和 Linux 上安装 node

curl -fsSL https://fnm.vercel.app/install | bash

# 新开一个terminal,让 fnm 生效

fnm install 24.3.0

fnm default 24.3.0

fnm use 24.3.0

# 安装 claude-code

npm install -g @anthropic-ai/claude-code --registry=https://registry.npmmirror.com

# 初始化配置

node --eval "

const homeDir = os.homedir();

const filePath = path.join(homeDir'.claude.on');

if (fs.existsSync(filePath)) {

const content = JSON.parse(fs.readFileSync(filePath'utf-8'));

fs.writeFileSync(filePath,JSON.stringify({ ...contenthasCompletedOnboarding: true }2)'utf-8');

} else {

fs.writeFileSync(filePath,JSON.stringify({ hasCompletedOnboarding: true })null'utf-8');

}"Windows

# 打开 windows 终端中的 powershell 终端

# windows 上安装 node

# 右键按 Windows 按钮,点击「终端」

# 然后依次执行下面的

winget install OpenJS.NodeJS

Set-ExecutionPolicy -Scope CurrentUser RemoteSigned

# 然后关闭终端窗口,新开一个终端窗口

# 安装 claude-code

npm install -g @anthropic-ai/claude-code --registry=https://registry.npmmirror.com

# 初始化配置

node --eval "

const homeDir = os.homedir();

const filePath = path.join(homeDir'.claude.on');

if (fs.existsSync(filePath)) {

const content = JSON.parse(fs.readFileSync(filePath'utf-8'));

fs.writeFileSync(filePath,JSON.stringify({ ...contenthasCompletedOnboarding: true }2)'utf-8');

} else {

fs.writeFileSync(filePath,JSON.stringify({ hasCompletedOnboarding: true })null'utf-8');

}"配置环境变量

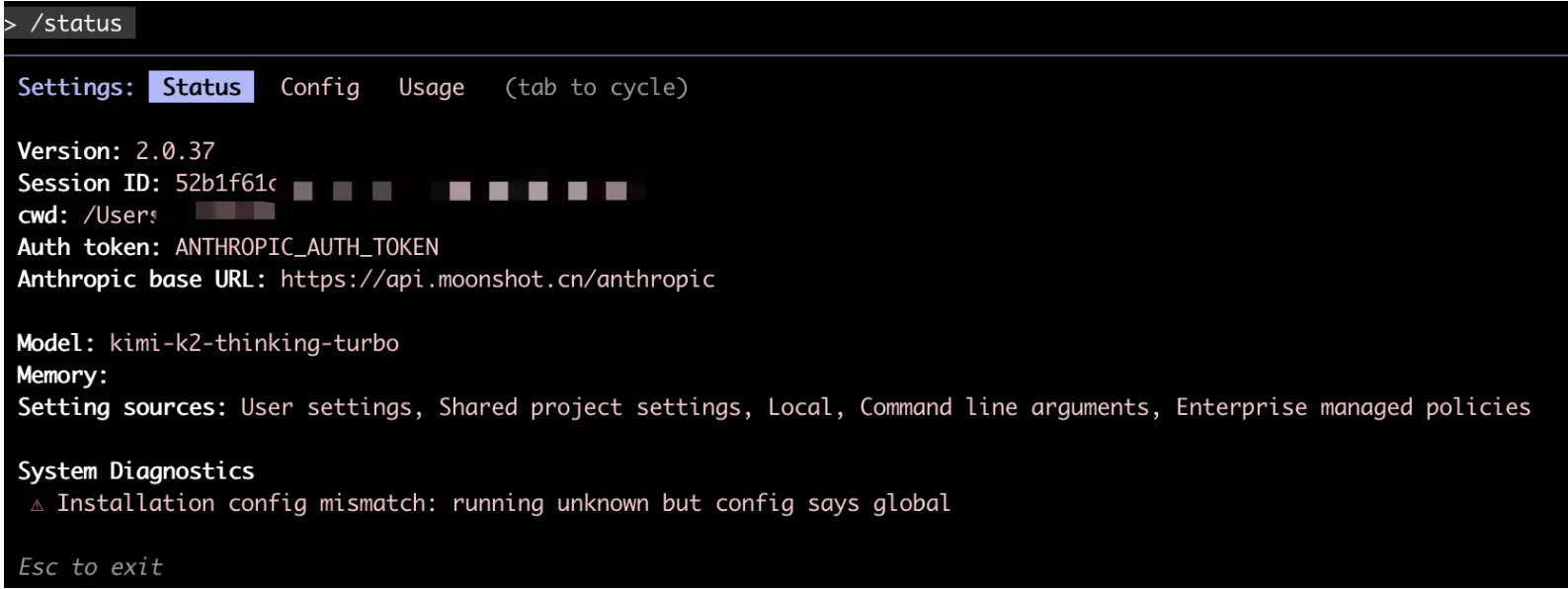

完成 Claude Code 安装后,请按照以下方式设置环境变量使用 kimi-k2-thinking-turbo 模型,并启动 Claude。

注:如果仍然需选择 kimi-k2 慢速版模型,可以将下方模型替换为 kimi-k2-thinking 来使用。

MacOS 和 Linux

# Linux/macOS 启动高速版 kimi-k2-thinking-turbo 模型

export ANTHROPIC_BASE_URL=https://api.moonshot.cn/anthropic

export ANTHROPIC_AUTH_TOKEN=${YOUR_MOONSHOT_API_KEY}

export ANTHROPIC_MODEL=kimi-k2-thinking-turbo

export ANTHROPIC_DEFAULT_OPUS_MODEL=kimi-k2-thinking-turbo

export ANTHROPIC_DEFAULT_SONNET_MODEL=kimi-k2-thinking-turbo

export ANTHROPIC_DEFAULT_HAIKU_MODEL=kimi-k2-thinking-turbo

export CLAUDE_CODE_SUBAGENT_MODEL=kimi-k2-thinking-turbo

claudeWindows

# Windows Powershell 启动高速版 kimi-k2-thinking-turbo 模型

$env:ANTHROPIC_BASE_URL="https://api.moonshot.cn/anthropic";

$env:ANTHROPIC_AUTH_TOKEN="YOUR_MOONSHOT_API_KEY"

$env:ANTHROPIC_MODEL="kimi-k2-thinking-turbo"

$env:ANTHROPIC_DEFAULT_OPUS_MODEL="kimi-k2-thinking-turbo"

$env:ANTHROPIC_DEFAULT_SONNET_MODEL="kimi-k2-thinking-turbo"

$env:ANTHROPIC_DEFAULT_HAIKU_MODEL="kimi-k2-thinking-turbo"

$env:CLAUDE_CODE_SUBAGENT_MODEL="kimi-k2-thinking-turbo"

claude确认环境变量是否生效

在Claude Code中输入/status确认模型状态:

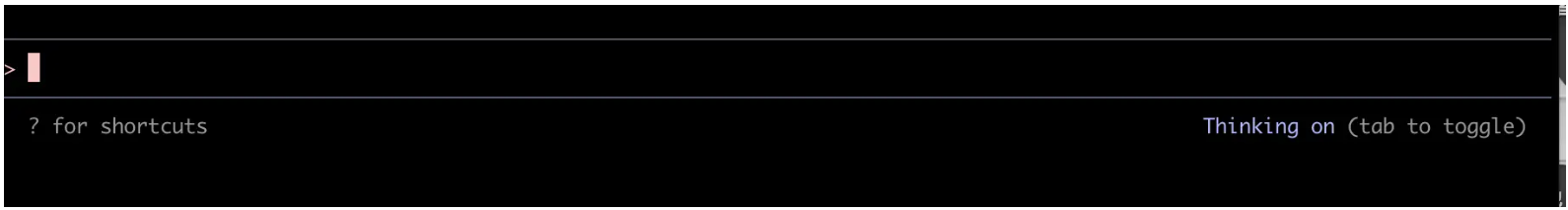

- 如何在 Claude Code 中体验

kimi-k2-thinking-turbo思考能力- 请在配置 turbo 模型后,进入 Claude Code 页面后点击

Tab按钮切换,切换成功可看到 "Thinking on" 的标识。

- 请在配置 turbo 模型后,进入 Claude Code 页面后点击

接下来就可以正常使用 Claude Code 进行开发了!

在 Claude Code 中使用 kimi-k2 非思考模型

安装 Claude Code

若您已安装好 Claude Code ,可以跳过这一步

MacOS 和 Linux

# MacOS 和 Linux 上安装 node

curl -fsSL https://fnm.vercel.app/install | bash

# 新开一个terminal,让 fnm 生效

fnm install 24.3.0

fnm default 24.3.0

fnm use 24.3.0

# 安装 claude-code

npm install -g @anthropic-ai/claude-code --registry=https://registry.npmmirror.com

# 初始化配置

node --eval "

const homeDir = os.homedir();

const filePath = path.join(homeDir'.claude.on');

if (fs.existsSync(filePath)) {

const content = JSON.parse(fs.readFileSync(filePath'utf-8'));

fs.writeFileSync(filePath,JSON.stringify({ ...contenthasCompletedOnboarding: true }2)'utf-8');

} else {

fs.writeFileSync(filePath,JSON.stringify({ hasCompletedOnboarding: true })null'utf-8');

}"Windows

# 打开 windows 终端中的 powershell 终端

# windows 上安装 node

# 右键按 Windows 按钮,点击「终端」

# 然后依次执行下面的

winget install OpenJS.NodeJS

Set-ExecutionPolicy -Scope CurrentUser RemoteSigned

# 然后关闭终端窗口,新开一个终端窗口

# 安装 claude-code

npm install -g @anthropic-ai/claude-code --registry=https://registry.npmmirror.com

# 初始化配置

node --eval "

const homeDir = os.homedir();

const filePath = path.join(homeDir'.claude.on');

if (fs.existsSync(filePath)) {

const content = JSON.parse(fs.readFileSync(filePath'utf-8'));

fs.writeFileSync(filePath,JSON.stringify({ ...contenthasCompletedOnboarding: true }2)'utf-8');

} else {

fs.writeFileSync(filePath,JSON.stringify({ hasCompletedOnboarding: true })null'utf-8');

}"配置环境变量

完成 Claude Code 安装后,请按照以下方式设置环境变量使用 kimi-k2-turbo-preview 模型,并启动 Claude。

注:如果仍然需选择 kimi-k2 慢速版模型,可以将下方模型替换为 kimi-k2-0905-preview 或 kimi-k2-0711-preview 来使用。

MacOS 和 Linux

# Linux/macOS 启动高速版 kimi-k2-turbo-preview 模型

export ANTHROPIC_BASE_URL=https://api.moonshot.cn/anthropic

export ANTHROPIC_AUTH_TOKEN=${YOUR_MOONSHOT_API_KEY}

export ANTHROPIC_MODEL=kimi-k2-turbo-preview

export ANTHROPIC_DEFAULT_OPUS_MODEL=kimi-k2-turbo-preview

export ANTHROPIC_DEFAULT_SONNET_MODEL=kimi-k2-turbo-preview

export ANTHROPIC_DEFAULT_HAIKU_MODEL=kimi-k2-turbo-preview

export CLAUDE_CODE_SUBAGENT_MODEL=kimi-k2-turbo-preview

claudeWindows

# Windows Powershell 启动高速版 kimi-k2-turbo-preview 模型

$env:ANTHROPIC_BASE_URL="https://api.moonshot.cn/anthropic";

$env:ANTHROPIC_AUTH_TOKEN="YOUR_MOONSHOT_API_KEY"

$env:ANTHROPIC_MODEL="kimi-k2-turbo-preview"

$env:ANTHROPIC_DEFAULT_OPUS_MODEL="kimi-k2-turbo-preview"

$env:ANTHROPIC_DEFAULT_SONNET_MODEL="kimi-k2-turbo-preview"

$env:ANTHROPIC_DEFAULT_HAIKU_MODEL="kimi-k2-turbo-preview"

$env:CLAUDE_CODE_SUBAGENT_MODEL="kimi-k2-turbo-preview"

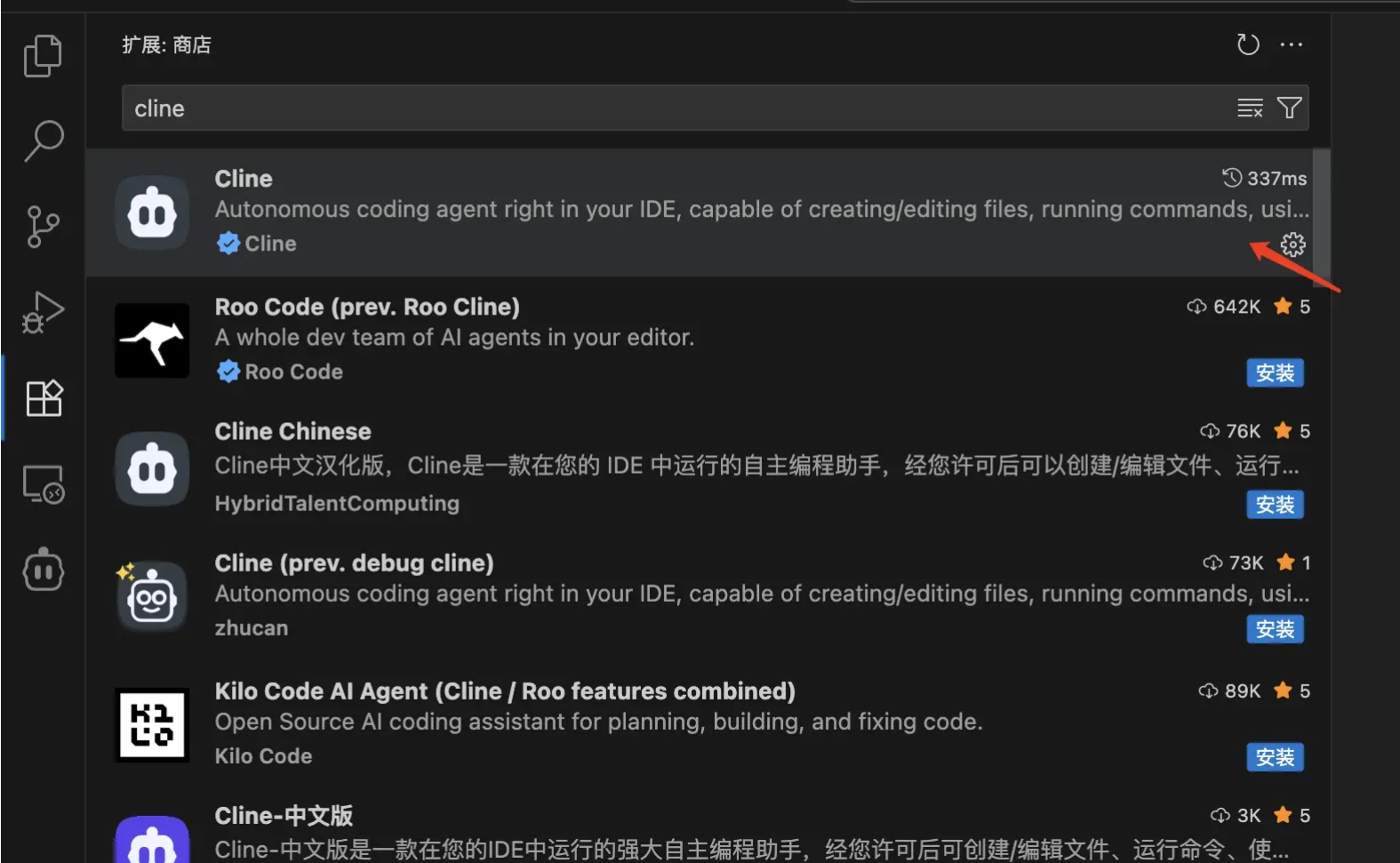

claude在 Cline 中使用 kimi k2 模型

安装 Cline

- 打开 VS Code

- 点击左侧活动栏中的扩展图标(或使用快捷键

Ctrl+Shift+X/Cmd+Shift+X) - 在搜索框中输入

cline - 找到

Cline扩展(通常由 Cline Team 发布) - 点击

Install按钮进行安装 - 安装完成后,可能需要重启 VS Code

验证安装

安装完成后,您可以:

- 在 VS Code 左侧活动栏中看到 Cline 图标

- 或者通过命令面板(

Ctrl+Shift+P/Cmd+Shift+P)搜索 "Cline" 相关命令来验证安装成功

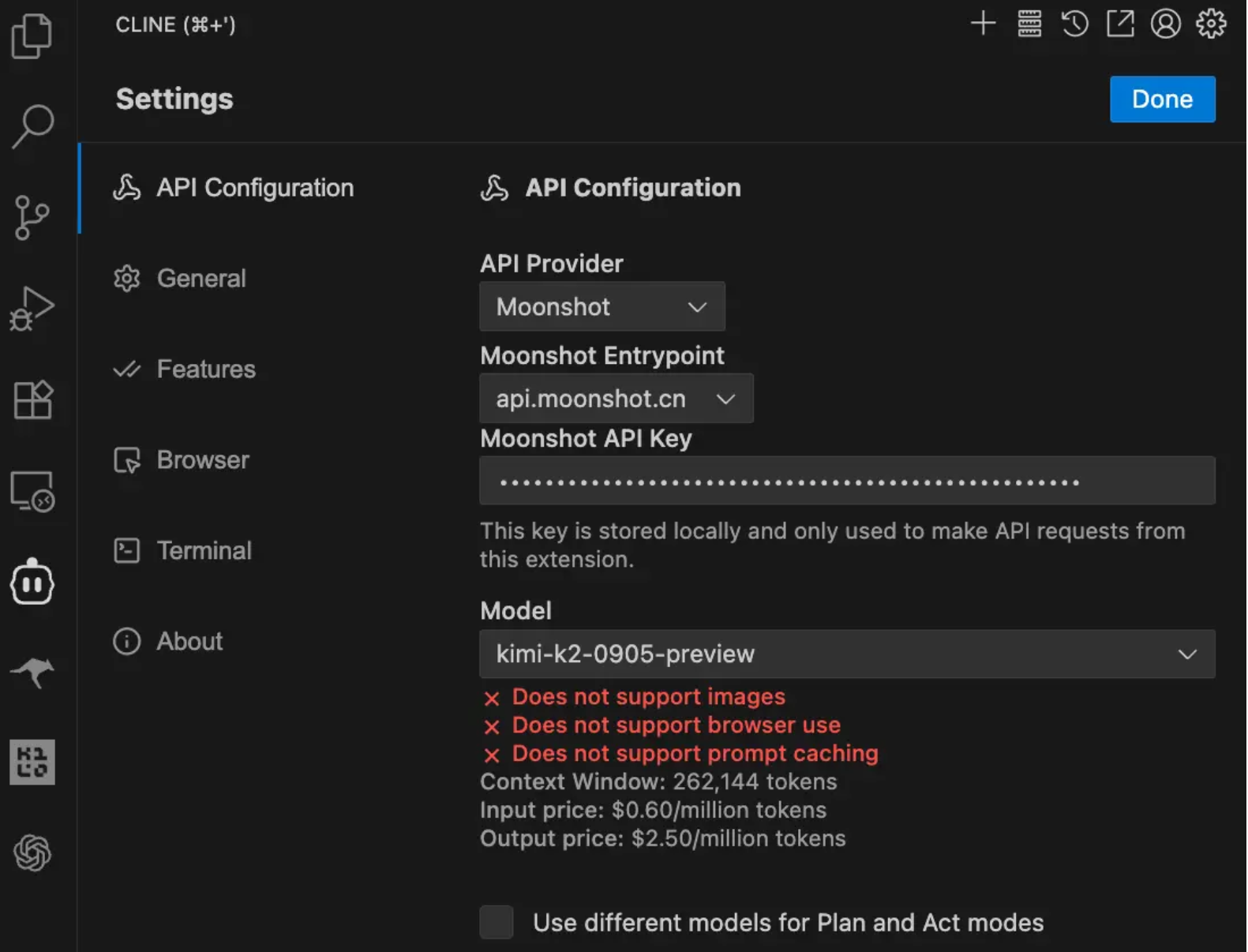

官方推荐:配置 Moonshot Provider 使用 kimi-k2 模型

- API Provider 选择 'Moonshot'

- Moonshot Entrypoint 选择 'api.moonshot.cn'

- Moonshot API Key 配置从 Kimi 开放平台获取的 Key

- Model 选择 'kimi-k2-0905-preview'

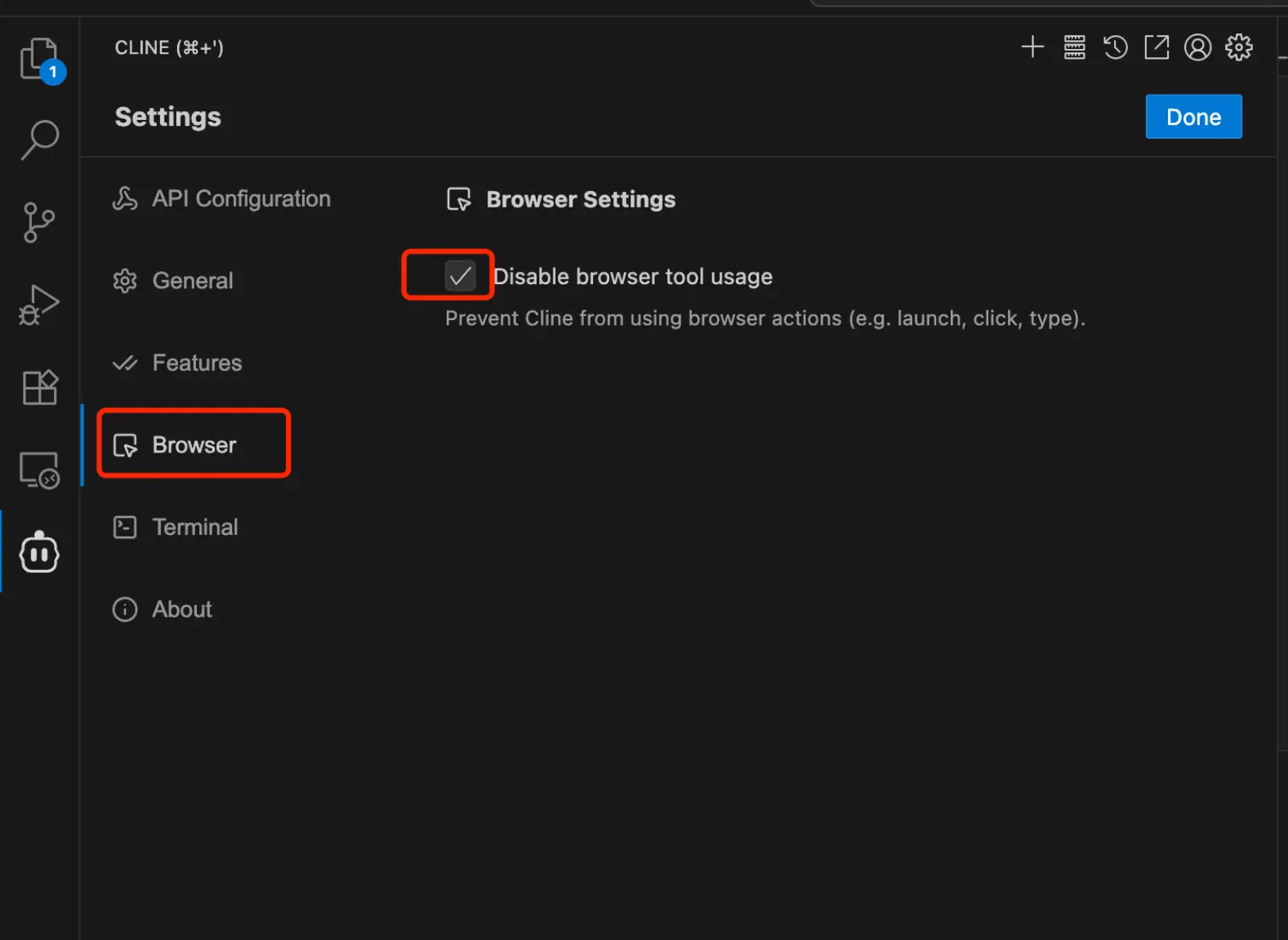

- Browser 勾选 'Disable browser tool usage'

- 点击'Done',保存配置

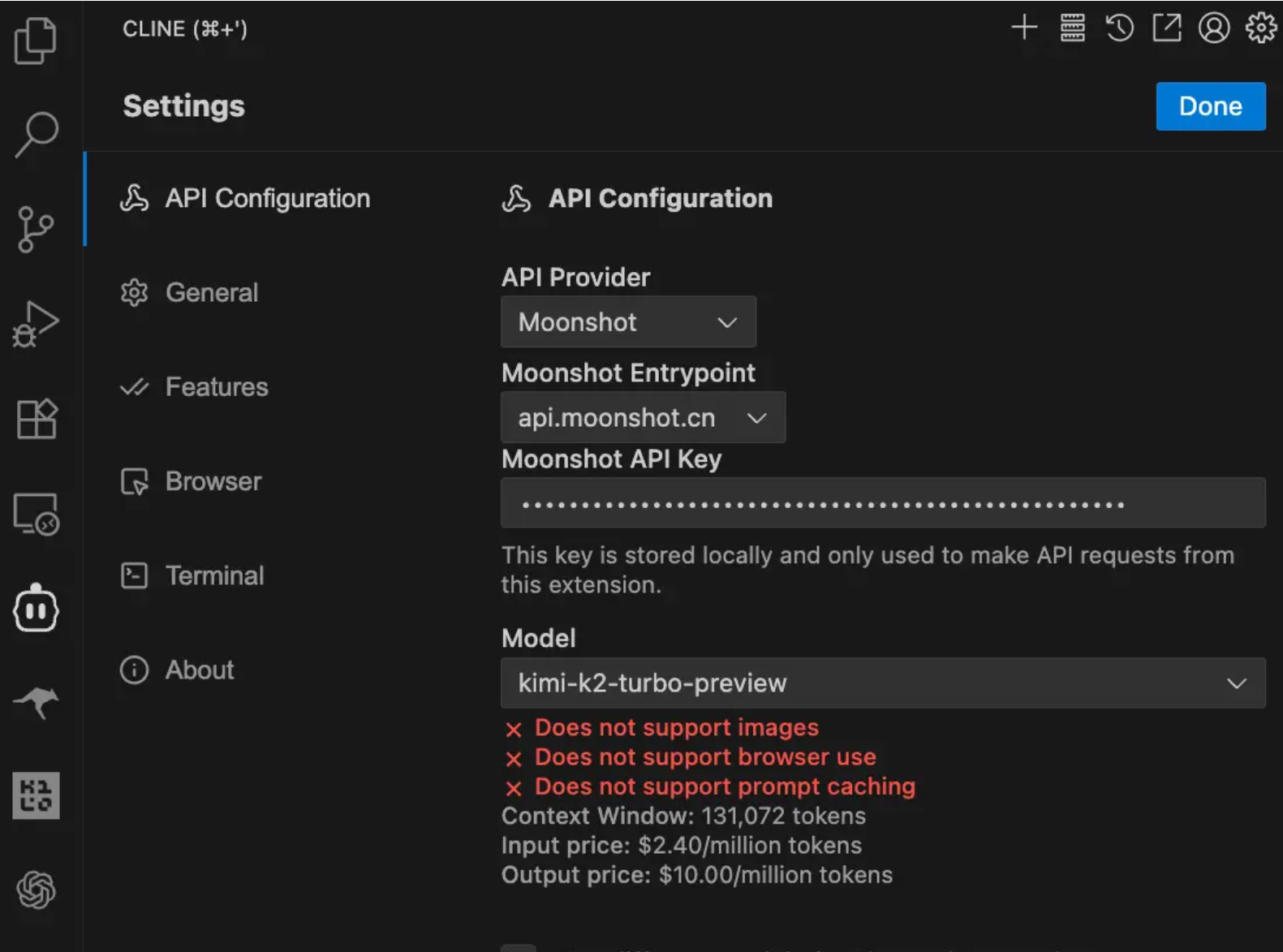

配置使用 kimi-k2-turbo-preview 模型

- 同上方配置 'kimi-k2-0905-preview' 模型的步骤一致,只需要将 Model 选择替换为 'kimi-k2-turbo-preview' 即可

- 点击'Done',保存配置

- 说明:'kimi-k2-turbo-preview' 模型上下文长度为 256k,这里的显示有误,请以官方平台的模型说明为准

在 RooCode 中使用 kimi k2 模型

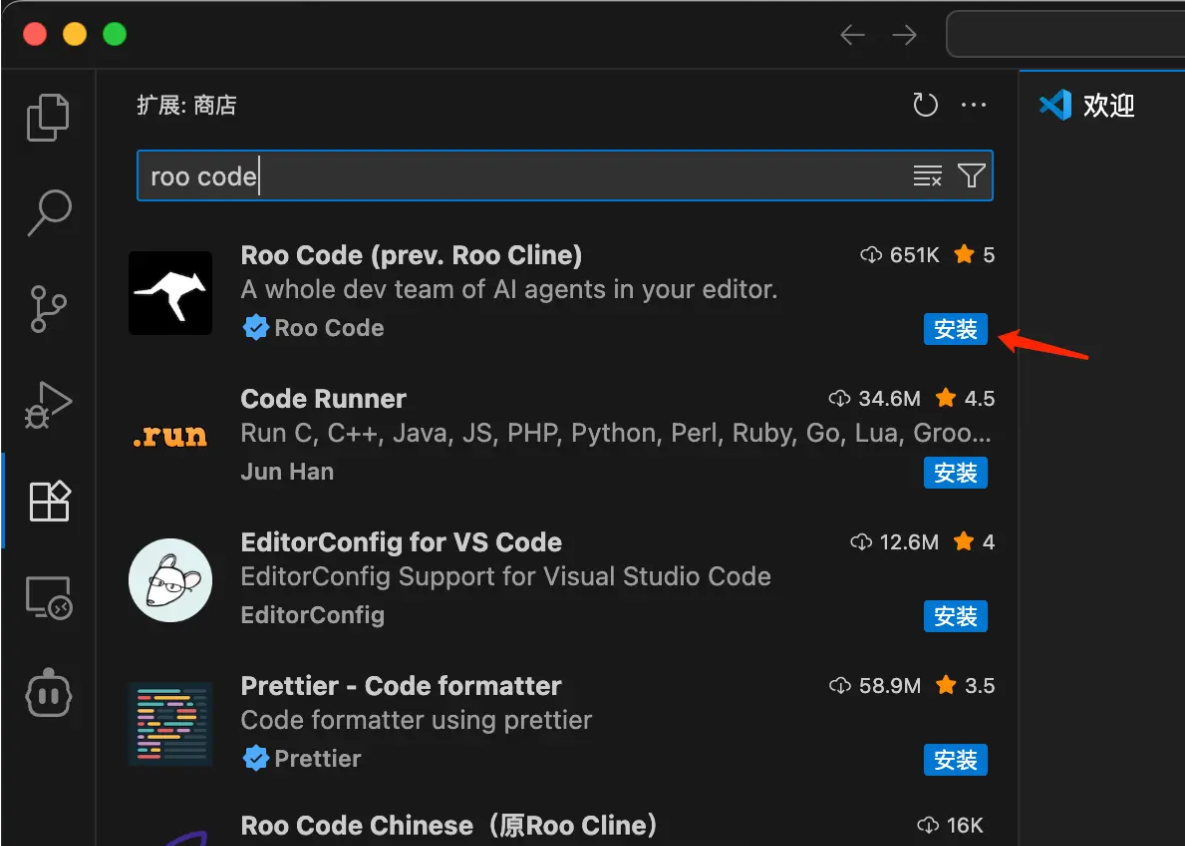

安装 RooCode

- 打开 VS Code

- 点击左侧活动栏中的扩展图标(或使用快捷键

Ctrl+Shift+X/Cmd+Shift+X) - 在搜索框中输入

roo code - 找到

Roo Code扩展(通常由 RooCode Team 发布) - 点击

安装按钮进行安装 - 安装完成后,可能需要重启 VS Code

验证安装

安装完成后,您可以:

- 在 VS Code 左侧活动栏中看到 RooCode 图标

- 或者通过命令面板(

Ctrl+Shift+P/Cmd+Shift+P)搜索 "RooCode" 相关命令来验证安装成功

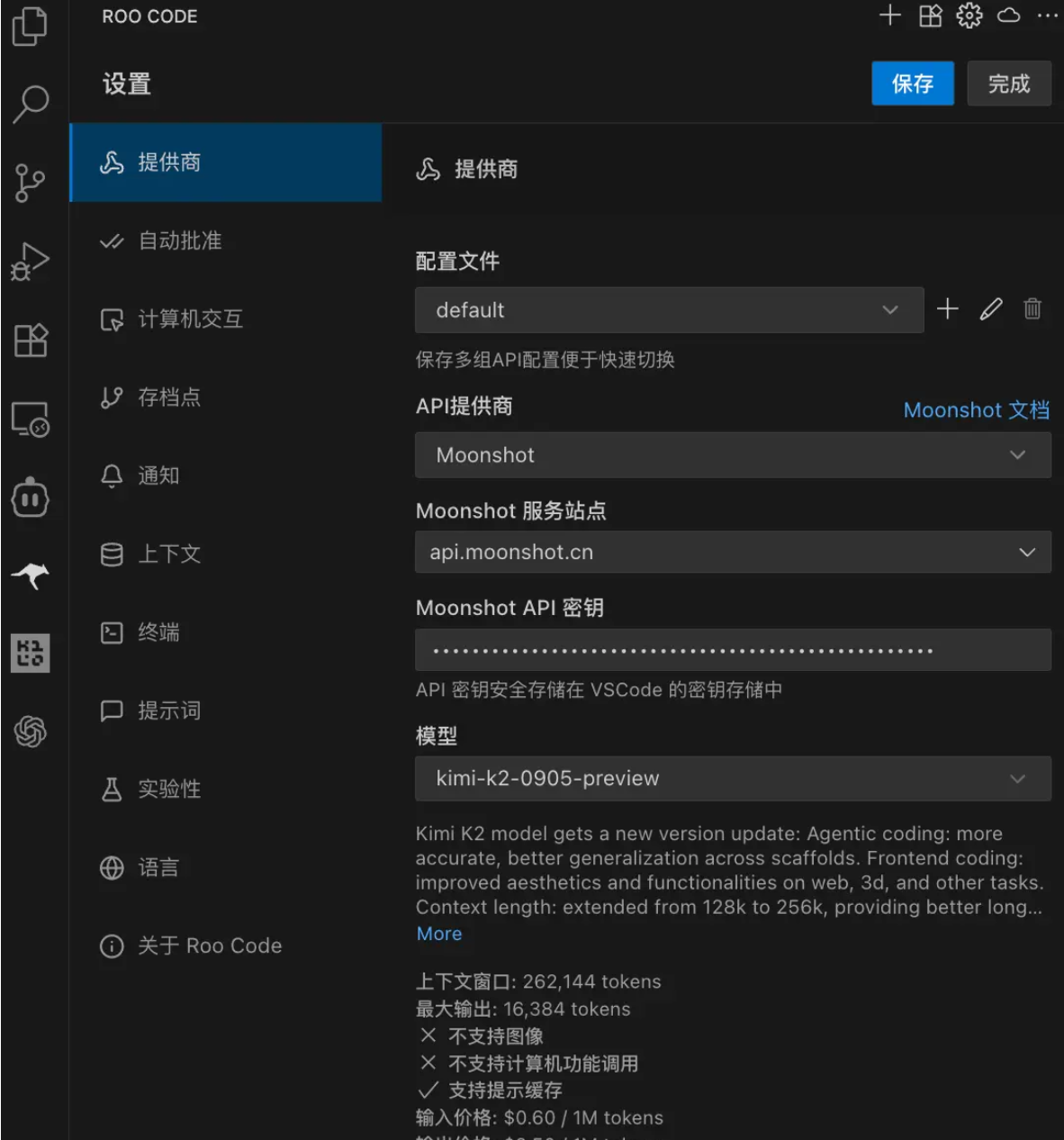

官方推荐:配置 Moonshot Provider 使用 kimi-k2 模型

- API Provider 选择 'Moonshot'

- Moonshot Entrypoint 选择 'api.moonshot.cn'

- Moonshot API Key 配置从 Kimi 开放平台获取的 Key

- Model 选择 'kimi-k2-0905-preview'

- Browser 勾选 'Disable browser tool usage'

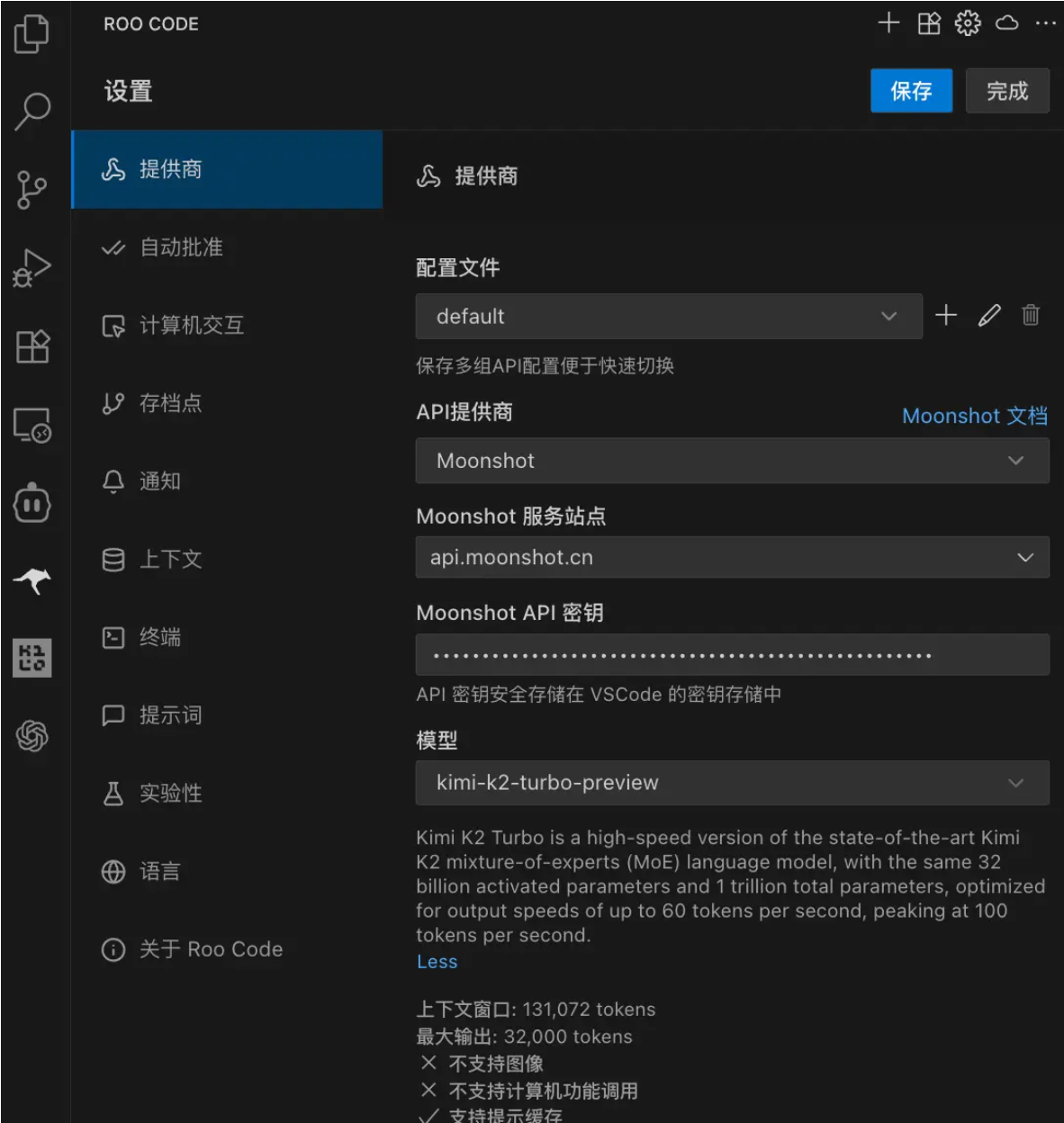

配置使用 kimi-k2-turbo-preview 模型

- 同上方配置 'kimi-k2-0905-preview' 模型的步骤一致,只需要将 Model 选择替换为 'kimi-k2-turbo-preview' 即可

- 点击'Done',保存配置

直接使用 API 调用 kimi-k2 模型

python

from openai import OpenAI

client = OpenAI(

api_key = "$MOONSHOT_API_KEY",

base_url = "https://api.moonshot.cn/v1",

)

completion = client.chat.completions.create(

model = "kimi-k2-0905-preview",

messages = [

{"role": "system""content": "你是 Kimi,由 Moonshot AI 提供的人工智能助手,你更擅长中文和英文的对话。你会为用户提供安全,有帮助,准确的回答。同时,你会拒绝一切涉及恐怖主义,种族歧视,黄色暴力等问题的回答。Moonshot AI 为专有名词,不可翻译成其他语言。"},

{"role": "user""content": "你好,我叫李雷,1+1等于多少?"}

],

temperature = 0.6,

)

print(completion.choices[0].message.content)curl

curl https://api.moonshot.cn/v1/chat/completions \

-H "Content-Type: application/on" \

-H "Authorization: Bearer $MOONSHOT_API_KEY" \

-d '{

"model": "kimi-k2-0905-preview",

"messages": [

{"role": "system""content": "你是 Kimi,由 Moonshot AI 提供的人工智能助手,你更擅长中文和英文的对话。你会为用户提供安全,有帮助,准确的回答。同时,你会拒绝一切涉及恐怖主义,种族歧视,黄色暴力等问题的回答。Moonshot AI 为专有名词,不可翻译成其他语言。"},

{"role": "user""content": "你好,我叫李雷,1+1等于多少?"}

],

"temperature": 0.6

}'node.

const OpenAI = require("openai");

const client = new OpenAI({

apiKey: "$MOONSHOT_API_KEY"

baseURL: "https://api.moonshot.cn/v1",

});

async function main() {

const completion = await client.chat.completions.create({

model: "kimi-k2-0905-preview"

messages: [

{role: "system"content: "你是 Kimi,由 Moonshot AI 提供的人工智能助手,你更擅长中文和英文的对话。你会为用户提供安全,有帮助,准确的回答。同时,你会拒绝一切涉及恐怖主义,种族歧视,黄色暴力等问题的回答。Moonshot AI 为专有名词,不可翻译成其他语言。"},

{role: "user"content: "你好,我叫李雷,1+1等于多少?"}

],

temperature: 0.6

});

console.log(completion.choices[0].message.content);

}

main();其中 $MOONSHOT_API_KEY 需要替换为您在平台上创建的 API Key。kimi-k2 模型 temperature 建议设置为 0.6,kimi-k2-0905-preview 256k 上下文模型,建议 max_tokens 设置为 32768。

如需使用 kimi-k2-turbo-preview 模型,请将模型名称替换为 kimi-k2-turbo-preview 即可。

使用 OpenAI SDK 时运行文档中的代码时,需要保证 Python 版本至少为 3.7.1,Node. 版本至少为 18,OpenAI SDK 版本不低于 1.0.0。

全攻略&spm=1001.2101.3001.5002&articleId=155545680&d=1&t=3&u=c57adf4946044706b7b6599ba3aabf9f)

1万+

1万+