国内外大模型的差距的论调一直存在,在2025年再来总结一下中美大模型之间的差距。

比如谷歌中国前负责人李开复给出的论述是,中国顶尖企业的大型语言模型大约落后美国同行6到9个月,而不太先进的中国模型可能落后美国大约15个月。

新加坡学者则指出,在企业应用上差距不大,但基础研究、软硬件和人才方面美国更强。美国吸引了全球46%的AI研究人员,而中国仅11%。不过,企业往往不会公开真实效果。周鸿祎则表示,大模型的差距不像芯片那么大,主要是软件问题,当前落后1到2年,但可逐步追赶。

其实在国内大模型的论调上,还有很多人表态,比如梁文峰等,AI方面,落后不像光刻机和芯片差距那么大,不管是ChatGPT,还是Sora,本质上还是软件,现在落后的时间,大概也就是一年到两年,是可以解决的。

AI 差距到底差在哪里?

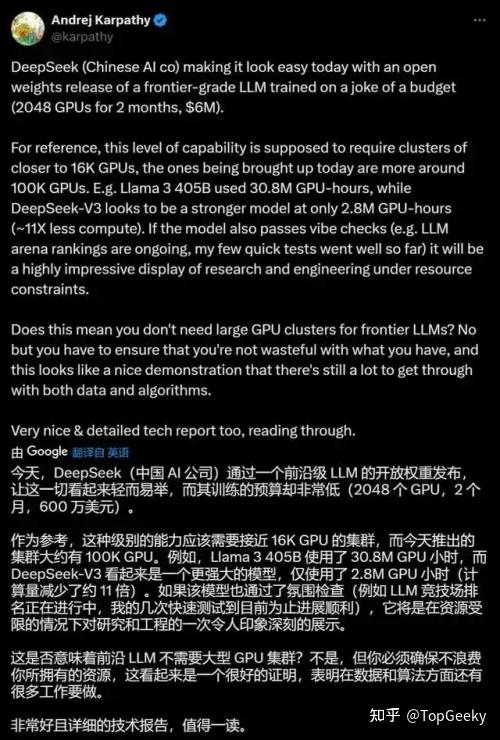

说到这里,不得不提出来一个我个人认为很有分量, 并且能够客观冷静的表述中外AI差距的人物了。DeepSeek已经火过两次的V2以及V3都不得不倒逼国内大模型价格的下降。

每天“看论文,写代码,参与小组讨论” 低调冷静的梁文锋,他的访谈上能够找到最为真实的中外大模型的差距。

从下面这段话就能看出来,他不是好的营销家,一定是一个优秀的实用主义。

多位行业人士和DeepSeek研究员告诉我们,梁文锋是当下中国AI界非常罕见的“兼具强大的infra工程能力和模型研究能力,又能调动资源”、“既可以从高处做精准判断,又可以在细节上强过一线研究员”的人,他拥有“令人恐怖的学习能力”,同时又“完全不像一个老板,而更像一个极客”。

中外AI的差距不是一年或两年,而是原创和模仿之差

其实V2发布时,硅谷就惊讶地称之为“来自东方的神秘力量”。DeepSeek创始人梁文锋2024年7月在接受媒体采访时说,硅谷习惯于将中国AI公司视为follow的角色,当一个中国公司以创新贡献者的身份,加入到他们游戏里去,而且表现优异时,他们就很震惊。

过去几年,AI界最流行的一个看法就是,如果说硅谷企业擅长从0到1,那我们则擅长从1到10,因为中国有宽广的应用市场。

从理性的角度,需要承认我们与OpenAI、Anthropic、DeepMind这些世界先进AI公司仍存在较大的差距。比如,即使是代表闭源大模型最前沿水平的V3,多项性能表现与GPT-4o相近,那也是后者7个月前的技术水平;而OpenAI这几个月已连续推出o1、o3这类新的“变异”物种。更何况,其他大多数的模型产品,放在多语言、多模态的国际视野看,差距要更大。

相对其他绝大部分中国公司既要选择研究模型,又在研究如何应用,梁文锋选择道路是着眼于研究探索上面。尽管很多中国公司习惯了别人做技术创新,自己拿过来做应用变现。

但是并不能将固有的摩尔定律看的理所应当,默默等着18个月就会有更好的AI架构然后再自己拿过来用。每一次更新都会有很多研究人员在默默付出,再过去以及现在一直是西方主导研究技术。

所以梁文锋关于AI差距的定义,他认为AI之差真正的差距不是一年或两年,而是原创和模仿之差。

现在互联网大厂都在布局AI赛道,争抢AI人才,不管是模型研究和AI应用的落地。很多小伙伴都苦于研究但是没有真正的时间能力,虽然理论掌握了一大堆,但是真实的开发落地的项目能力十分欠缺,所以我给小伙伴们推荐知乎知学堂推出的AI大模型课程, 从理论入手,包括比如Transfermer结构、成熟的大语言模型结构、模型的变体、优化、改进等等,最重要的是和你真实有效的完成AI开发工作,帮助你提升AI浪潮的职场技能。

这个课程只要你有兴趣,必须花一点时间来学习一下,根据老师讲的步骤一步步落地自己的大模型项目,才算真实有效的入门AI大模型领域。

国内突破原创之路

国外的优势: OpenAI、Google等在基础研究领域拥有世界级的科学家团队,并且长期投入大量资源,推动了诸多突破性研究。例如,Transformer架构的提出(Google),深度学习框架PyTorch]和TensorFlow的广泛应用,以及GPT系列模型的发展(OpenAI),都是国外技术团队的成果。最重要的一点就是AI芯片带来的海量算力。

国内的进步: 国内的绝大多数模型都是再次基础上进行拓展,通义千问、文心一言、云雀大模型等等,但是这些模型似乎没有特别突出效果,都是向着OpenAI的追赶,第一梯队仍然和国外的大模型紧紧跟随。但是在未来算力程度上,国内的AI环境相较于国外更容易出现Scaling Law的瓶颈。

就简单的取个例子,OpenAI的训练方法是‘大水漫灌式’,拿来的数据放到‘黑盒’里训练,一次不行再试一次,直到行为止,因此很烧钱;在国内的DeepSeek是先一步利用算法,对数据进行总结和分类,然后输送给大模型,类似把目录和框架先给到大模型,再将所有内容,按照这个分类和知识点,训练大模型理解并掌握。这意味着大模型的训练相比‘黑盒’变得更加规律和透明化。

对于未来的AI竞争来说,可能出现断代的情况可能是,是国内外AI芯片提供算力相差过大,国外的研究出现质的突破,以及国内大模型研究领域人才的确实。

创新之路漫漫,吾辈将上下而求索。